近日,南边科技年夜学深港微电子学院交流博士生,中国香港年夜学博士生管子义于年夜语言模子量化范畴取患上新进展,相干算法量化结果 APTQ: Attention-aware Post-Training Mixed-Precision Quantization for Large Language Models 被EDA范畴最顶级的集会国际设计主动化集会(Design Automation Conference, DAC 2024)接管。

DAC集会是集成电路辅助设计(EDA)及嵌入式体系范畴的国际最权势巨子集会, 迄今已经有跨越50年的汗青,重要存眷芯片、电路以和体系设计的新东西及新要领。是中国计较机学会(CCF)保举的计较机系统布局与高机能计较标的目的的A类顶级国际学术集会,该集会近两年的论文吸收率为20%摆布。

为相识决年夜语言模子LLM参数目过浩劫以部署的问题,本项研究提出了APTQ(留意力感知的混淆精度练习后量化技能),这是一种立异的年夜型语言模子量化计谋。APTQ技能不仅综合思量了模子层权重的二阶信息,还有初次纳入了留意力机制输出对于模子总体的非线性影响,使用Hessian迹作为混淆精度敏感度的评估指标,以实此刻维持模子机能的同时对于模子举行压缩量化。试验证实,APTQ于连结模子机能的基础上实现了平均4位宽器量化,并于C4数据集上到达了与全精度模子险些相称的困惑度,同时于LLaMa-7B及LLaMa-13B模子上实现了于知识推理零样本进修使命中的高机能,证实了APTQ于量化年夜语言模子的鲁棒性。

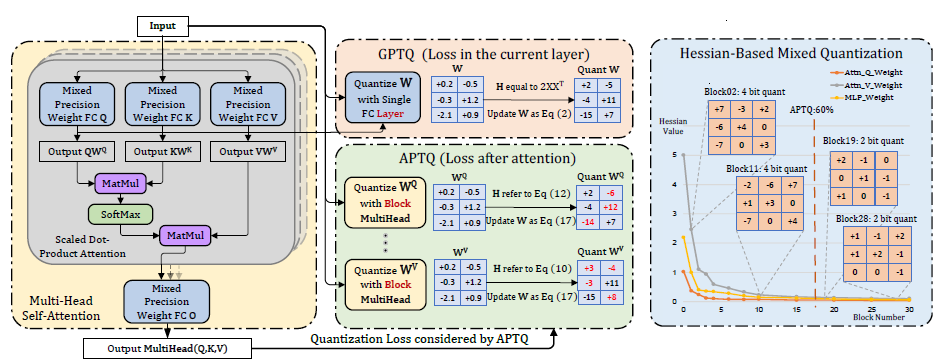

图一展示了APTQ的整体架构,它将周全的Transformer留意力阐发与特定层的Hessian量化联合起来,从而加强了对于模子的理解。

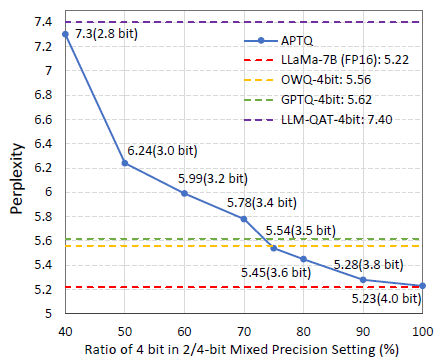

图二比力了于C4数据集上利用APTQ的LLaMa-7B模子于差别4位比特量化下与其他量化要领的困惑度成果,证实了APTQ于混淆精度设置中的优胜性。

文章以南边科技年夜学为第一完成单元,深港微电子学院交流博士生管子义为第一作者。相干事情于深港微电子学院余浩传授课题组和中国香港年夜学黄毅传授课题组的引导下完成,并获得了深圳市科创委-深圳市高条理人材项目及深圳市科创委-基础研究重点项目的撑持。

-米兰milan